中美AI博弈的最新焦点:“知识蒸馏”和“蒸馏攻击”

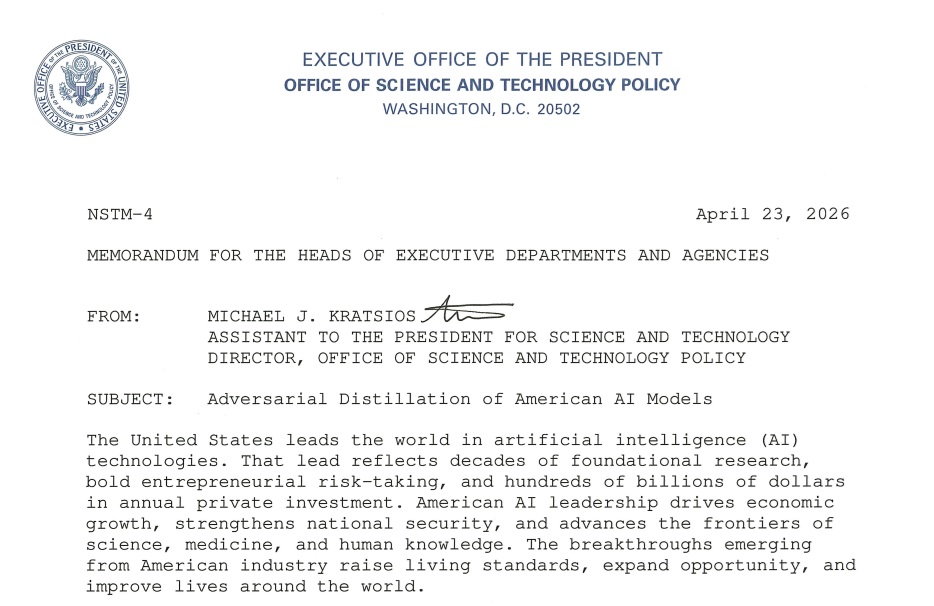

上星期四,即4月23日,特朗普政府白宫科技政策办公室主任克拉齐奥斯(Michael John Kotsakas Kratsios)发出备忘录,指责中国政府支持黑客开展“蓄意的、工业规模的活动”,对美国的前沿人工智能模型进行“提炼和复制”。这一指控将中美人工智能领域的竞争推向了更具对抗性的境地,并可能使特朗普即将进行的北京之行变得更加复杂。

【点击这里下载克拉齐奥斯备忘录】

所谓“蓄意的、工业规模的活动”,是指中方黑客通过API(应用程序编程接口)对美国的高质量AI模型查询数百万次,以构建能够复制系统行为方式的数据集,使得中方能够以极低的成本具备复制看起来与美国人工智能相当的能力。

这种行为被称之为“蒸馏攻击”(distillation attacks),这是一个在 AI 安全领域非常关键的概念。简单来说,蒸馏攻击是指攻击者通过大量访问一个高质量的“黑盒”模型(又称目标模型或受害者模型),获取其输出,并利用这些数据训练出一个功能极其相似的本地“学生”模型,从而“克隆”或窃取原模型的功能。经过足够的训练,这个本地模型能够表现出与目标模型高度一致的行为,从而实现了模型的“窃取”。

“知识蒸馏”本身是一项非常有用的技术(用于压缩模型,使其在手机等设备上运行),但当它被恶意用于“克隆”他人的商业模型时,就演变成了“蒸馏攻击”。这不仅涉及数据安全,更直接威胁到 AI 企业的商业竞争力和知识产权。

这些公司均明确否认了这些指控,并强调其模型是基于自主研发和大规模原生数据训练的。

DeepSeek(深度求索)是目前争议的核心,因其以极低的训练成本实现了惊人的性能。

指控方(如 Anthropic、部分分析师)曾公开指责 DeepSeek(以及其他一些公司)利用大量对 Claude 或 GPT 的查询,将其作为“老师”模型,收集其输出的推理路径和结果,用来训练或微调自己的模型。在这些公司看来,这不仅是“蒸馏”,更是通过工业级规模的“窃取”行为来加速自身模型的性能提升。

DeepSeek 的支持者认为,它是一个正式的 AI 研发机构(DeepSeek-AI)。它有自己的模型架构、训练集群(据说部分由华为支持)和庞大的研发团队。它提供的是经过数万亿 token 训练的原创基座模型,并非仅仅是套壳。DeepSeek 的崛起很大程度上是因为它展示了在相同算力下,通过架构创新(如 MoE 架构、长上下文处理)可以极大降低训练成本。它并不是一个完全依靠“复制粘贴”生成的产物,但它是否在某个训练阶段使用了竞争对手的输出数据来辅助优化,这是一个很难从外部完全证实的“灰度”问题。

AI 行业目前正处于一个微妙的阶段,定义“学习”与“窃取”的界限非常困难:

几乎所有的模型(包括 GPT 和 Claude)在训练时,都会大量抓取互联网上的公开数据。只要这些数据是公开的,这种训练被普遍认为是合法的。

如果一家公司专门编写脚本,大规模地向竞争对手的 API 发送请求,并利用返回的优质回答来训练自己的模型,这被许多闭源模型公司视为“不正当竞争”或“非法提取”。

AI 目前是中美科技竞争的最前沿。指控“窃取”或“克隆”往往伴随着外交压力、制裁威胁和贸易谈判。这些指控在目前阶段大多基于情报分析或推测,缺乏公开的技术审计报告或法律定论。

知识蒸馏在 AI 学术界是一项基础技术。当“蒸馏”被用于开源模型改进时被视为进步,当被用于追赶闭源商业模型时,就会被竞争对手视为“窃取”。这种界限在目前国际法律中尚不清晰,因此容易成为各方攻击的理由。

作者

-

作者为北美知名时政评论人、本站特约专栏作家。